OpenClaw 模型选择指导手册(国内外主流模型)

分钟阅读

💬 公众号1. 背景:被高昂的模型 API 账单“打醒”

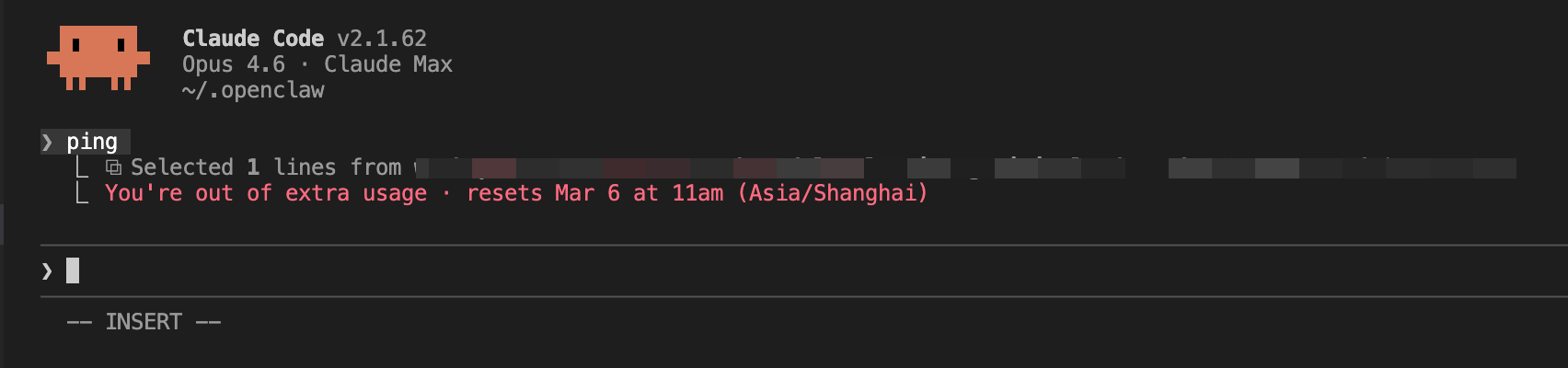

周三晚上,准备让龙虾哥跑个批量分析任务,半天没有反应,于是打开终端看了下,额度已经耗尽。

回头翻看系统配置,其实我平时也用 Claude Opus 4.6、Sonnet 4.6,以及 Gemini 3.1 Pro 和 Gemini 3 Flash,并不是无脑全甩给 Claude。但很多时候为了图省事,默认配置没切好,导致大把轻量任务也跑在了昂贵的模型上:

- 抓个网页、洗个格式,用 Sonnet;

- 跑个简单的定时器,用 Sonnet;

- 就连纯视觉审查,也用最顶配的模型。

这简直就是拿高射炮打蚊子。

其实,当前国内外有大量极具性价比的模型。为此,我花时间系统整理了 2026 年 3 月的主流 AI 模型。目标就一个:给不同任务匹配“刚刚好”的模型,把钱花在刀刃上。

2. 核心结论与选型表(30秒版)

先说大白话结论,你可以直接抄作业配置到自己的 Agent 路由里:

- 日常主力干活:海外优先 Claude Sonnet 4.6,国内平替 MiniMax M2.5。

- 打杂与轻量任务(抓网页、格式化、小脚本):优先 Gemini 3 Flash 或 豆包 Seed 2.0 Mini,又快又便宜。

- 啃超长文档/看庞大老代码库:首推 Kimi K2.5。

- 全自动写代码/改Bug:海外上 OpenAI GPT-5.3-Codex;国内强推 MiniMax M2.5。

- 高难度推理与复杂决策:遇到瓶颈再切 Gemini 3.1 Pro 或 Qwen3-Max-Thinking。

- 国产业务与中文特化:千问 Qwen3.5-Plus。

附:OpenClaw 当前使用的模型分发路由表(仅供参考):

| 任务类型 | 推荐首选 | 降本备选 | 选择理由 |

|---|---|---|---|

| 抓取/总结/翻译/格式化 | Gemini 3 Flash | 豆包 Mini | 速度极快,成本极低,适合跑批 |

| 前端代码生成/界面切图 | Gemini 3 Flash | 豆包 Seed 2.0 Code | 专门优化视觉转代码,看图写UI强 |

| 后端代码/业务逻辑 | Claude Sonnet 4.6 | MiniMax M2.5 | 逻辑严谨,输出极稳定 |

| 简单脚本/CLI任务 | Gemini 3 Flash | 豆包 Seed 2.0 Mini | 执行明确的简单指令不吃推理算力 |

| 中文规范/业务老代码 | 千问 Qwen3.5-Plus | — | 中文生态和本地代码规范理解最透彻 |

| 高频交互/终端调试 | MiniMax M2.5 | GLM-4.7 | 极快响应,便宜不心疼,适合高频试错 |

| 超长文档解析/Agent群 | Kimi K2.5 | — | 上下文超大,群智能力强 |

| 复杂工程重构 (长时任务) | OpenAI Codex | Claude Opus | 专攻代码闭环与长周期自治任务 |

| 深度推演/战略级决策 | Gemini 3.1 Pro | Qwen Thinking | 顶级推理算力,解决极少数的难题 |

3. 主流模型实战点评

不用去看繁杂的跑分(如 SWE-Bench 测代码、GPQA 测科研),实战体验才是硬道理。

3.1 海外三巨头(Claude / Gemini / OpenAI)

Claude 4.6 系列(Anthropic)

- Sonnet 4.6 是目前综合性价比之王。日常代码、文档编写、任务规划,选它绝不翻车。

- Opus 4.6 只有在极少部分变态级推理场景下才有优势,平时别开,太贵。

Gemini 3.1 系列(Google)

- Flash 款 是真正的干活机器,速度极快。处理简单的格式化、爬虫总结等“脏活累活”首选。

- Pro 款 在最新跑分里超越了 Opus,适合企业级重型决策和深层数学逻辑。

Codex 5.3 (OpenAI)

- 专为“全自动写代码”设计的数字员工。如果你让 Agent 跑几十条终端命令、改遍整个代码库,它的持久力和长周期自我纠错能力最强。

3.2 国产主力:卷出高性价比

现在的国产模型,在写代码和日常推理上,完全能平替海外的大部分场景,且成本只有几分之一甚至几十分之一。

- 千问 Qwen3.5-Plus:中文代码库、本土老系统、国内特有的业务规范,找千问看懂的最快。

- 豆包 Doubao Seed 2.0:特别是它的 Code 版本,对前端同学极度友好,贴张设计图,直接出高还原度代码。

- MiniMax M2.5:国产黑马,响应速度极快,在终端密集调试、高频试错的任务中,好用且省钱。

- Kimi K2.5:啃几十万字的超长文档、分析庞大的报错日志,它的长文本能力依然是最让人安心的。

- DeepSeek V3.2 / R2:算法竞赛级选手。如果你需要搞定极其复杂的数学推导,或者对成本敏感到了极致,选它。

- GLM-4.7:在调用各种 API 工具、生成各类界面(比如直接输出网页或 PPT 代码)上,适配度极高。

4. 经验总结

给你的 AI Agent 配置模型路由时,记住这三个原则:

- 别用大炮打蚊子:80% 的日常任务,Sonnet 或国产模型完全能搞定。

- 术业有专攻:前端切图用豆包,读巨型文档用 Kimi,全栈重构用 Codex,对症下药。

- 多备“平替”:把国产模型设为降级备选(Fallback)。当主模型卡壳或限流时,Agent 依然能自动顶上。

智能体的真正威力,不仅在于聪明,更在于“把对的脑力用在对的地方”。

关注刘贺同学,一起探索 AI Agent 的更多可能,下期见。